Seperti halnya prosedur statistik lainnya, analisis regresi memiliki beberapa asumsi dan keterbatasan. Walaupun demikian, dalam analis di dunia praktis, tindakan, atau keputusan nyata, terkadang mengabaikan beberapa asumsi-asumsi ini. Tetapi, asumsi-asumsi yang menjadi asumsi dasar wajib untuk dipenuhi.

Pengabaian dari beberapa asumsi yang bukan asumsi dasar ini tentunya mengakibatkan resiko-resiko tertentu. Sebagai resiko ketika salah satu asumsi tidak terpenuhi adalah model regresi menjadi kurang dapat diandalkan. Namun tidak berarti tidak bisa digunakan. Sebaliknya jika semua asumsi terpenuhi maka model regresi tersebut bisa sangat powerfull untuk digunakan. Model regresi yang memenuhi beberapa asumsi biasanya disebut dengan istilah BLUE (Best Linear Unbiased Estimator).

Model regresi dikatakan BLUE menurut teorema Gauss-Markov (Carl Friedrich Gauss dan Andrey Markov) bila model regresi linier memiliki kesalahan (residual) yang mendekati nol, tidak berkorelasi dan memiliki varian yang sama. “Terbaik” berarti mempunyai varians estimasi terendah, dibandingkan dengan estimator linier yang tidak bias lainnya. Residual tidak perlu normal, tidak perlu independen ataupun terdistribusi secara identik, namun harus tetap tidak berkorelasi dengan mean nol dan homoskedastik pada varian tertentu.

Berikut ini asumsi-asumsi model regresi yang saya sampaikan secara singkat:

Asumsi 1

Untuk setiap nilai X, ada nilai Y yang sesuai. Karena analisis regresi merupakan analisis sampel berpasangan jadi setiap nilai Y pada satu sampel selalu ada nilai X.

Asumsi 2

Nilai-nilai variabel Y harus distribusi normal. Bila tidak terdistribusi normal ada pengembangan model regresi lain misalnya model regresi logit, probit atau tobit.

Asumsi 3

Jumlah pengamatan harus lebih besar dari jumlah variabelnya. Jika jumlah variabel ada 3 maka jumlah pengamatan atau sampel minimal adalah 4. Ini dapat diamati secara langsung dengan melihat data, tanpa melakukan pengujian.

Asumsi 4

Variabilitas nilai X adalah positif. Ini berarti nilai-nilai X dalam sampel yang digunakan tidak boleh semuanya sama atau hampir sama. Cara melihatnya dengan melihat nilai varians setiap variabel.

Asumsi 5

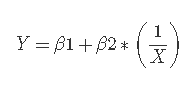

Model regresi ditentukan dengan benar. Ini berarti bahwa jika variabel Y dan X memiliki hubungan terbalik, persamaan model harus ditentukan dengan tepat:

Asumsi 6

Parameter model regresi adalah linier. Contoh persamaan model yang linear dalam parameter

Y = a + b1X1 + b2X2 + e

Meskipun, X2 dinaikkan sampai dua kali, persamaannya masih linear dalam parameter beta. Jadi asumsi terpenuhi.

Asumsi 7

Rata-rata residu adalah nol. Bagaimana cara mengeceknya? Periksa rata-rata residu. Jika nol atau sangat dekat dengan 0, maka asumsi ini terpenuhi.

Asumsi 8

Homoscedasticity residual, yaitu semua gangguan atau residual dalam fungsi regresi memiliki varians yang sama atau tidak terjadi heteroskedastik. Bagaimana cara mengeceknya?. Ada beberapa metode yang dapat digunakan untuk mengidentifikasi adanya heteroskedastisitas, diantaranya adalah:

- Metode Grafik

- Uji Park

- Uji Gelser

- Uji Korelasi Spearman

- Uji Goldfeld-Quandt

- Uji Brues-Pagan-Godfrey

- Uji White

Asumsi 9

Tidak ada autokorelasi residu. Autokorelasi merupakan hubungan residual satu observasi dengan residual observasi yang lain. Autokorelasi adalah korelasi dari Time Series dengan kelambatannya sendiri. Ketika residu mengalami autokorelasi, itu berarti bahwa nilai saat ini tergantung dari nilai-nilai (historis) sebelumnya dan bahwa ada pola pasti yang tidak dapat dijelaskan dalam variabel Y yang muncul dalam gangguan.

Autokorelasi ini berlaku terutama untuk data deret waktu (time series), walaupun demikian bukan berarti pada data cross section autokorelasi tidak penting.

Metode yang sering digunakan untuk mendeteksi terjadinya autokorelasi adalah Uji Durbin-Watson dan Uji Breusch-Godfrey.

Asumsi 10

Tidak ada multikolinieritas sempurna. Tidak ada hubungan linear yang sempurna di antara variabel penjelas (independen). Terjadinya multikolinieritas dapat kita deteksi melalui hal-hal berikut:

- Nilai R2 yang tinggi, tetapi sebagian besar variabel independen secara parsial tidak memiliki pengaruh signifikan terhadap variabel dependen

- Menghitung koefisien korelasi antar variabel independen

- Melakukan regresi auxiliary.

Asumsi 11

Normalitas residu, dimana residu harus didistribusikan secara normal. Para peneliti berpendapat bila data setiap variabel yang diteliti lebih dari 30, maka sudah terdistribusi normal. Misalnya bila ada 3 variabel yaitu satu variabel dependen dan dua variabel independen, maka data minimal yang dibutuhkan adalah 3 X 30 = 90.

Walaupun jumlah data tersebut sudah terpenuhi, untuk mendapatkan informasi yang lebih akurat sebaiknya dianalisis menggunakan histogram dan uji Jarque-Bera.

Asumsi 12

Variabel X dan residu tidak berkorelasi. Asumsi ini pada dasarnya hampir sama dengan asumsi homoskedastisitas. Bila residu berkorelasi signifikan dengan variabel X maka sudah dipastikan asumsi homoskedastis tidak terpenuhi. Cara mengecek asumsi ini adalah dengan melakukan uji korelasi pada variabel X dan residual.

7 comments